L’intelligence artificielle révolutionne le monde de la musique, transformant la création, la production et l’expérience d’écoute. Cette technologie en pleine expansion s’immisce dans tous les aspects de l’industrie musicale, de la composition automatique au mastering en passant par l’identification rapide de chansons et leur analyse…

Accordons nos violons et remontons un peu l’histoire

La production musicale a toujours dansé au rythme de l’innovation. Du premier phonographe à la fin du XIXe siècle jusqu’aux synthétiseurs qui ont fait « vibrer » les sixties, chaque nouvelle technologie a réorchestré notre définition de la musique.

L’ère numérique a considérablement accéléré cette progression. Les ordinateurs, les synthétiseurs, les logiciels et les stations de travail audio numériques ont transformé la manière dont nous concevons et produisons la musique, permettant de créer des compositions riches et complexes à partir de simples sons.

Cette révolution numérique a joué les premières mesures d’un morceau encore plus ambitieux : l’entrée en scène de l’intelligence artificielle dans la production musicale. L’IA s’annonce donc comme un outil capable de repousser encore plus loin les frontières de la création sonore, promettant de redéfinir une fois de plus notre approche de la musique.

Un remplaçant du compositeur ?

L’introduction de l’IA dans la musique n’est pas seulement un nouveau chapitre, c’est presque un nouveau genre. Des systèmes d’IA sont capables de composer à la manière d’autres compositeurs de façon très convaincante. Cependant, la capacité de l’intelligence artificielle à créer des compositions qui touchent véritablement l’âme humaine, reste un sujet de débat.

S’il semble indispensable de sensibiliser les élèves aux défis éthiques que pose la création artistique avec l’IA (ainsi que les problèmes de droits d’auteur qui ne sont toujours pas réglés), il est intéressant de pouvoir les faire réfléchir également à d’autres utilisations de l’intelligence artificielle en musique.

Trois exemples récents illustrent l’impact profond et varié de l’IA sur le paysage musical :

L’album novateur de Skygge

Benoît Carré est un artiste français (membre fondateur du trio Lilicub avec qui il est nommé pour une Victoire de la musique en 1997 pour la chanson « Voyage en Italie »). Il s’intéresse très tôt aux possibilités qu’offre l’intelligence artificielle, notamment en collaboration avec les chercheurs du laboratoire Sony Computer Science Laboratory.

En 2016, avec François Pachet et Flow machines, l’IA des chercheurs de Sony, il compose « Daddy’s car », un titre inspiré de The Beatles. Pour ce faire, ils « nourrissent » l’IA de 56 titres du mythique groupe britannique. « Daddy’s car » marque un point important dans l’histoire des IA Génératives.

En 2018, Skygge a sorti « Hello World », le premier album pop composé avec l’aide de l’IA. Ce projet explore les possibilités créatives offertes par les algorithmes, repoussant les limites de la composition musicale traditionnelle.

Il invite 15 artistes à collaborer avec lui (dont Stromae ou The Pirouettes). Flow Machines est incrémenté de centaines de partitions et Skygge lui demande d’en créer une nouvelle « à la manière de ». Il est très intéressant de noter que les artistes se servent ensuite des biais, des hallucinations ainsi proposées par l’IA.

Voir le making off du projet :

Par exemple, pour le titre « Hello shadow », Skygge a collaboré avec Stromae qui a « nourri » l’IA d’influences de la musique cap-verdienne. Il a ensuite sélectionné des fragments mélodiques sur la partition obtenue, des extraits de guitare et des voix générées ont été amalgamées pour former un chœur sur le refrain. Stromae a improvisé une ligne mélodique sur le pré refrain et il a fait interpréter la chanteuse Kiesza. Une collaboration Humains-Machine innovante et passionnante, dont le résultat est à écouter :

La résurrection numérique de Farinelli

Carlo Maria Michelangelo Nicola Broschi, dit Farinelli, né en 1705 dans le royaume de Naples, est un chanteur baroque à la virtuosité et à la voix surhumaines. Inouïe, prodigieuse, surnaturelle, cette voix qui lui vaut le statut de superstar est contrainte. En effet, Farinelli, remarqué dès son plus jeune âge pour ses talents de chanteur, a subi, vers l’âge de 10 ans, une castration.

Jusqu’au XIXe siècle, les femmes se voyaient interdire l’accès au chant dans les lieux de culte. Cette prohibition, ancrée dans une interprétation stricte des textes religieux, a conduit à une situation paradoxale : comment interpréter les parties aiguës des compositions sacrées en l’absence de voix féminines ? Face à ce défi, deux options principales s’offraient aux interprètes masculins. Certains chanteurs développaient l’usage de leur « voix de tête », également appelée voix de fausset (les falsettistes). Une alternative plus radicale, aujourd’hui considérée comme barbare, était également employée : la castration pré-pubère de jeunes garçons doués pour le chant (l’absence de sécrétion de testostérone empêchant la mue vocale). Plus qu’à l’Église, les Castrats, au XVIIe et au XVIIIe siècles étaient très prisés à l’Opéra.

La voix d’un castrat était véritablement singulière, ne pouvant être assimilée ni à celle d’une femme, ni à celle d’un homme, ni même à celle d’un enfant. Cette unicité provenait de la combinaison de plusieurs facteurs physiologiques : une tessiture étendue (leur registre vocal était souvent exceptionnel, pouvant aller du registre de soprano à celui de contralto), un timbre clair et lumineux (les castrats conservaient le timbre de leur voix d’enfant) et une puissance vocale d’adulte (grâce au développement normal de leur cage thoracique). Farinelli est l’un des castrats les plus remarqués, alliant un timbre exceptionnel à un ambitus (une tessiture, l’ensemble des notes qui peuvent être émises par une voix sans difficulté) hors du commun de 3 octaves !

Pour le film « Farinelli », en 1994, Gérard Corbiau a tenté de recréer cette voix phénoménale, en combinant les voix d’un homme et d’une femme. L’ingénieur du son Jean-Claude Gaberel a utilisé les aigus de la soprano et les graves du contre-ténor. Après sept mois de travail méticuleux sur les ordinateurs de l’IRCAM (Institut de Recherche et Coordination Acoustique Musique), est née la première voix reconstituée non synthétique au monde. Le résultat est saisissant.

En 2021, l’artiste Judith Deschamps, en collaboration avec les chercheurs de l’IRCAM, a travaillé sur la recréation de cette voix unique, avec l’intelligence artificielle, dans la continuité des travaux de 1994 pour le film de Corbiau.

Ce projet fascinant combine des enregistrements de chanteurs contemporains et des données historiques pour donner vie à une voix perdue depuis des siècles.

Farinelli avait un ambitus vocal impressionnant. Pour recréer sa voix légendaire, il a d’abord été nécessaire d’étudier les partitions annotées par Farinelli lui-même et d’enregistrer plusieurs types de voix : deux enfants sopranos, une chanteuse soprano, un contre-ténor et un ténor léger. Une chanteuse alto a interprété le chant pour faire le lien entre toutes les voix.

Les réseaux profonds de l’IA sont entraînés avec la voix de chanteurs et de chanteuses et les chercheurs ont élaboré des méthodes permettant de produire un chant hybride, incorporant les spécificités de chaque voix à partir de paramètres de contrôle externes, ou automatiquement, en fonction de la hauteur chantée.

L’IA a également été entraînée à improviser, une caractéristique importante du style de Farinelli.

Le projet s’est concentré sur la recréation de l’air « Quell’usignolo che innamorato » (« Ce rossignol amoureux »), que Farinelli chantait régulièrement au roi Philippe V d’Espagne.

Le résultat n’est pas une reconstitution exacte, mais plutôt une création artistique inspirée par les capacités vocales extraordinaires de Farinelli. Les biais, les « erreurs » de la machine et ses limites sont intégrés dans le résultat, témoignant du côté déjà artificiel de cette voix, résultat d’une opération inhumaine pratiquée sur le jeune garçon.

A voir un documentaire étonnant de France Musique qui détaille le projet :

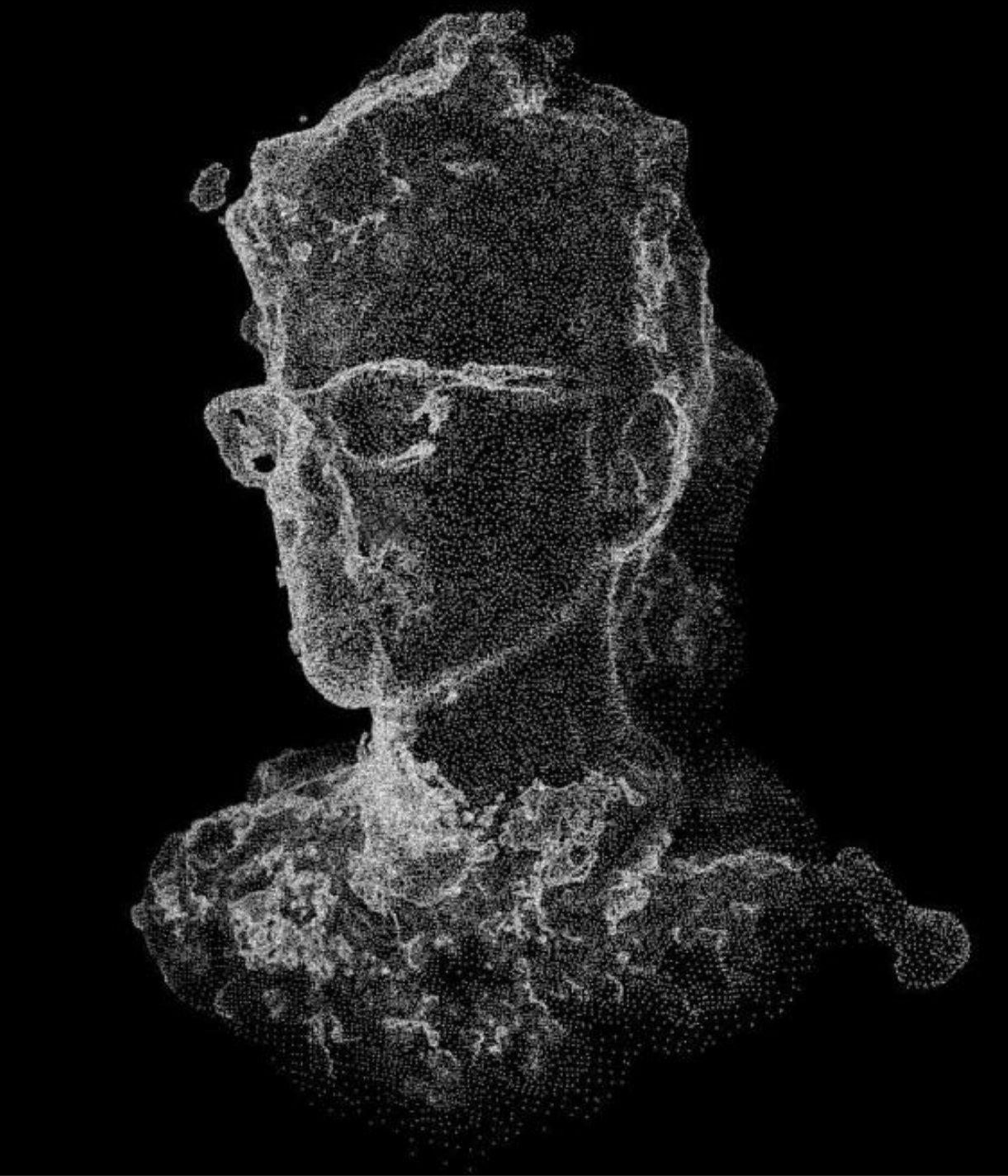

La controverse des Beatles aux Grammy Awards

56 ans après la séparation du groupe, 44 ans après la mort de John Lennon et 23 ans après celle de George Harrison, les Beatles sont sacrés aux Grammy Awards 2025 en remportant le titre de « meilleure performance rock de l’année » pour « Now and Then ».

La création de « Now and Then », le dernier morceau des Beatles sorti en novembre 2023, est le résultat d’un long processus impliquant à la fois des enregistrements historiques et des technologies modernes.

Ce morceau a été écrit et enregistré par John Lennon à la fin des années 1970, sur une cassette intitulée « Pour Paul » (remise aux autres Beatles par Yoko Ono en 1994).

Le groupe tente alors de finaliser la chanson en 1995 mais abandonne le projet en raison de la qualité insuffisante de l’enregistrement. George Harrison qualifie alors le morceau de « fucking rubbish »…

En 2021, une technologie d’IA développée pour Peter Jackson permet d’extraire la voix de Lennon. L’IA sépare la voix du piano, créant une piste vocale claire. Les enregistrements de guitare de George Harrison datant de 1995 sont intégrés et Paul McCartney et Ringo Starr complètent le morceau en studio en ajoutant une batterie, une basse et un piano.

Dans ce projet donc, l’IA n’a été utilisée que pour nettoyer et isoler la voix de Lennon (une révolution dans le monde des ingénieurs du son !), pas de création artificielle ou de synthèse vocale. La nomination et la victoire de ce titre aux Grammy suscitent néanmoins la polémique et posent des questions d’ordre éthique quant à la création artistique assistée par la machine…

Il faut toutefois écouter ce titre, accompagné d’un clip vidéo réalisé par Peter Jackson (ce qui, vous en conviendrez, ne gâche rien) :

Conclusion

Ces exemples démontrent comment l’IA transforme non seulement la façon dont nous créons et consommons la musique, mais aussi comment elle nous pousse à repenser notre relation avec l’art et la technologie.

L’intégration de l’IA dans la production musicale suscite un débat aussi vieux que l’innovation elle-même : les nouvelles technologies enrichissent-elles la boîte à outils de l’artiste ou menacent-elles l’âme même de l’authenticité artistique ?

Et si nous demandons à l’IA elle-même si elle est capable de créer de la musique comme Chopin ou Rachmaninov, voilà ce qu’elle nous répond (requête envoyée à l’IA Perplexity) : « Il est important de noter que l’IA ne peut pas véritablement « composer comme » Chopin ou Rachmaninov dans le sens où elle ne possède pas leur génie créatif, leur expérience vécue ou leur sensibilité émotionnelle unique. L’IA peut imiter certains aspects de leur style, mais elle ne peut pas reproduire la profondeur et la complexité de leur art. »

Modeste ou maline… mieux vaut imaginer créer avec l’IA que de lui laisser les clés de la créativité à l’avenir !

NB : hormis Farinelli, les Beatles et Skygge, toutes les images sont à mettre au crédit de l’IA Raphael.